Version imprimable du sujet

Cliquez ici pour voir ce sujet dans son format original

Forums MacBidouille _ Photo _ Photographier un DVD

Écrit par : Laszlo Lebrun 11 Mar 2022, 23:35

Bonsoir,

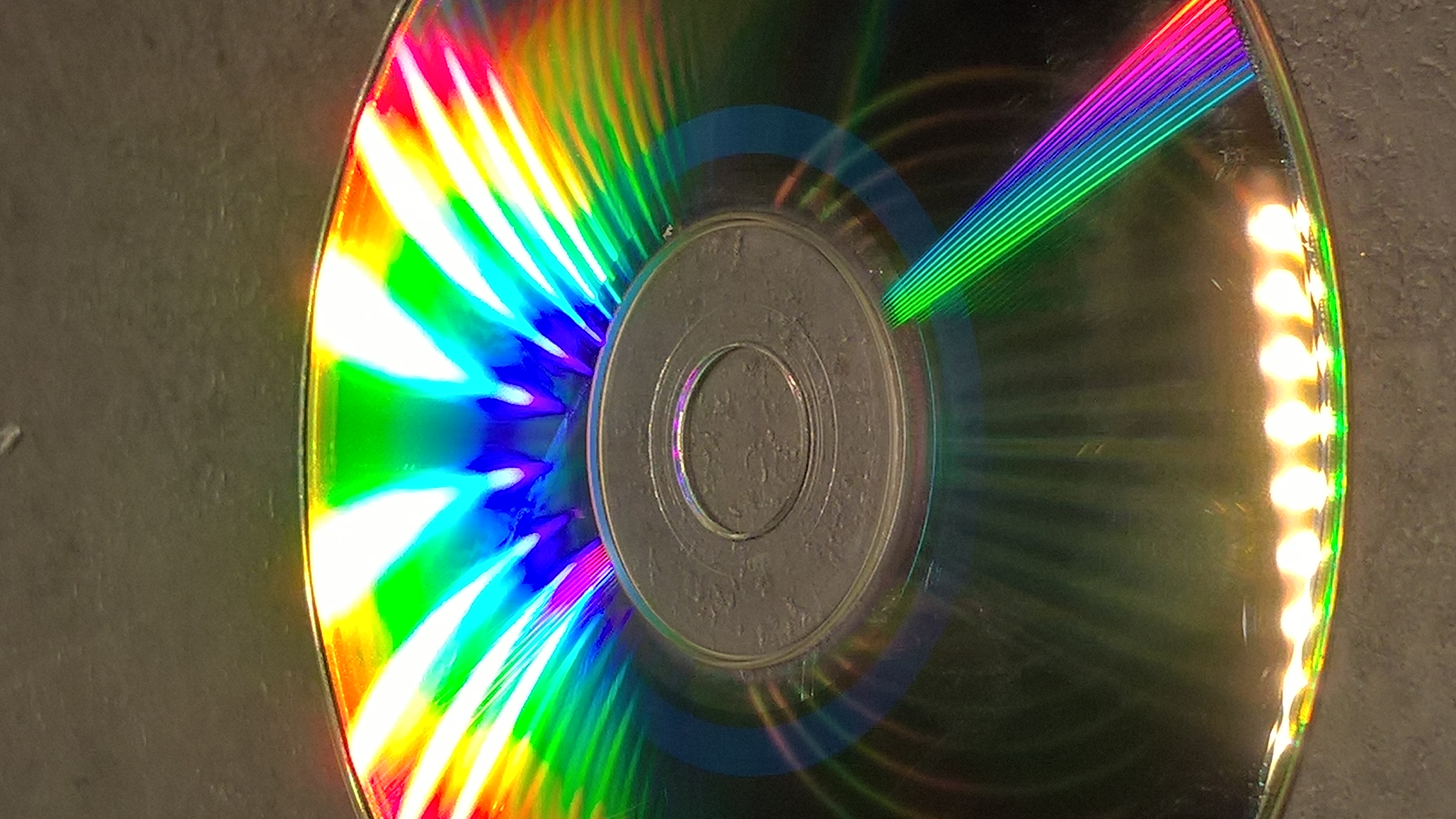

Incidemment j'ai passé un DVD sous l' éclairage d'une barre de 16 leds.

L'effet de prisme formé a généré un graphique extrêmement intéressant que j'ai voulu photographier.

D'abord avec mon Lumia 950 que j'utilise en général pour faire les photos de mes bricolages, ensuite avec mon DSLR Nikon

En fait je me suis trouvé extrêmement déçu par le résultat.

Les photos se trouvent soit surexposées, soit sous-exposées avec des couleurs sursaturées et un gammut catastrophique.

Ce n'est absolument pas ce que je vois.

Comment faites-vous, vous les experts en photo?

J'ai l'impression, que ce type de photo est un test de la mort qui tue pour appareils photo digitaux!

Écrit par : annapurna 12 Mar 2022, 08:40

bonjour,

les 12 leds ne sont pas adaptées pour ce genre de photo.

Il faut travailler avec une boite à lumière qui va diffuser la lumière uniformément sur la surface.

Ici une taille A3 est adaptée.

bon week-end

Écrit par : Laszlo Lebrun 12 Mar 2022, 09:07

les 12 leds ne sont pas adaptées pour ce genre de photo.

Il faut travailler avec une boite à lumière qui va diffuser la lumière uniformément sur la surface.

Ici une taille A3 est adaptée.

bon week-end

Merci, mais ce n'est pas ce que je veux.

Je veux l'effet arc-en-ciel dû aux leds, pas un éclairage diffus.

Je veux surtout réussir à obtenir une photo correspondant à ce que je vois.

Les capteurs CMOS semblent complètement dépassés par la dynamique de l'image.

Écrit par : nadia 12 Mar 2022, 10:06

Il faut essayé avec un filtre polarisant... ![]()

Écrit par : DOMY 12 Mar 2022, 16:24

Tout ça me rappelle qu'il y avait jadis un topic dédié à la photo, ici.

Il a disparu ?

Écrit par : Laszlo Lebrun 12 Mar 2022, 16:33

et le vois-tu comme ça? avec du blanc ou ta photo est aussi sursaturée?

Écrit par : jeandemi 12 Mar 2022, 16:46

Il y a un problème de dynamique insuffisante des capteurs

Si ton appareil dispose d'un mode HDR, il faut essayer ça

Sinon une série en bracketting d'exposition, et réunir l'ensemble dans un logiciel style Photoshop

Écrit par : GIJoe 12 Mar 2022, 16:54

Il a disparu ?

Salut DOMY,

le sieur Click-Clack en fut un bon animateur.

Écrit par : Laszlo Lebrun 12 Mar 2022, 17:31

Si ton appareil dispose d'un mode HDR, il faut essayer ça

Sinon une série en bracketting d'exposition, et réunir l'ensemble dans un logiciel style Photoshop

Oui, mais il faut un vrai HDR en bracketting de diaphragme, pas d'exposition.

En tout cas ce test est excellent pour séparer les mauvais Smartphones des bons.

Si le capteur sature, aucun logiciel ne saura ratrapper ça.

Écrit par : jeandemi 12 Mar 2022, 18:06

Heu ?

Si tu ne change pas l'exposition, tu auras toujours les HL brûlées et les BL enterrées

Tu peux faire varier l'exposition en jouant sur le diaphragme et/ou la vitesse, il vaut mieux laisser la sensibilité à celle native du capteur, c'est là que la dynamique est la plus grande

Écrit par : ades 12 Mar 2022, 18:41

interessant, mais je me pose une question, je comprend à peu près ce qu'est le HDR, mais je ne sais pas ce que c'est quest un braketing de diaphragme, si quelqu'un peut m'éclairer, marci

Parceque du temps où j'utilisait de la tri X et du brovira (comprenne qui pourra) l'exposition c'était la quantité de lumière reçue par la surface sensible, donc avec un diaph donné prendant un temps donné, quand on ouvrait d'un diaphragme fallait diviser par 2 le temps d'exposition et inversement… ça a changé ?

Écrit par : Laszlo Lebrun 12 Mar 2022, 19:31

Parceque du temps où j'utilisait de la tri X et du brovira (comprenne qui pourra) l'exposition c'était la quantité de lumière reçue par la surface sensible, donc avec un diaph donné prendant un temps donné, quand on ouvrait d'un diaphragme fallait diviser par 2 le temps d'exposition et inversement… ça a changé ?

Oui, les CCD sont trop rapides pour ne pas saturer en eclairage violent.

Il faut jouer sur le diaphagme, ce que la majorité des smartphones ne peuvent pas faire.

Écrit par : ades 12 Mar 2022, 20:20

ça ne me dit pas ce que c'est qu'un braketing de diaphragme et pas d'exposition !

et puis si c'est trop sensible faut juste avoir un filtre gris neutre, matériel courant non ?

Écrit par : jeandemi 13 Mar 2022, 10:30

Un bracketting, c'est à la base une série de vues prises à des expositions différentes

Par exemple : -2IL, -1IL, 0, +1IL, +2IL

On utilisait ça par exemple en diapositive (qui a une latitude d'exposition faible), quand on n'était pas sûr du bon réglage à adopter, on était ainsi sûr d'en avoir une bonne dans la série.

Avec le numérique (qui a également une latitude d'expo faible), de nouvelles possibilités sont apparues, comme le fait de faire du HDR (High Dynamic Range). Le logiciel HDR va prendre les informations dans les ombres du fichier surexposé, ainsi que dans les hautes lumières du fichier sous-exposé, pour composer un fichier contenant un maximum d'informations tant dans les HL que les BL (mais à faible contraste)

D'autres types de bracketting sont également apparus, comme celui de mise au point, qui permet de recomposer un fichier avec une grande profondeur de champ

Écrit par : ades 13 Mar 2022, 12:21

je sais ce que c'est un braketing .

C'est la phrase "Oui, mais il faut un vrai HDR en bracketting de diaphragme, pas d'exposition." qui m'interpelle c'est quoi la différence entre un braketing de diaphragme et un braketing d'exposition ????

L'exposition est, me semble-t-il, et depuis très longtemps, déterminée par la sensibilité de support (les ISO) le temps d'exposition (la vitesse) et le diaphragme. pour arriver à une sous ex, soit on ferme le diaph (et MERDE, on n'a plus de profondeur de champ), soit on augmente diminue le temps d'exposition (avantage ça diminue aussi les flous de bouger, en cas de palu breton) changer les iso en les diminuant change aussi l'exposition, à condition de garder le même couple diaph/vitesse, mais pas les caractéristique du capteur .

Si j'ai à peu près compris, la sensibilité de base d'un capteur (en tous cas pour les D### de chez Nikon) c'est 100 iso (p'tet 200, ma mémoire flanche parfois et pas le temps de vérifier sur la doc) ![]() .

.

Écrit par : Laszlo Lebrun 13 Mar 2022, 15:22

C'est la phrase "Oui, mais il faut un vrai HDR en bracketting de diaphragme, pas d'exposition." qui m'interpelle c'est quoi la différence entre un braketing de diaphragme et un braketing d'exposition ????

Pour faire un bracketting de diaphragme, encore faut-il avoir un diapragme réglable par logiciel. Cen 'est pas le cas de la plupart des smartphones.

Le problème c'est que les capteurs digitaux soint loins d'être linéaires:

voir cette photo massivement sous ex (ISO100, 10mS):

A ce niveau de contraste il n'y a plus de gammut du tout, c'est carrément des gros pâtés de vert, de jaune, de rouge etc.

Une pellicule intègere assez bien la quantité de lumière, en fonction des temps de pose, les CCD saturent en quelques mS et ca donne ça.

Écrit par : ades 13 Mar 2022, 15:31

donc il faut faire des photos avec un appareil ad hoc ![]()

![]()

![]() mais si tu ne peux pas changer la valeur du diaphragme, suffirait de changer la durée de l'exposition non ?

mais si tu ne peux pas changer la valeur du diaphragme, suffirait de changer la durée de l'exposition non ?

edit, PS Y-a même des softs qui font du HDR (pseudo?) à partir d'une seule prise de vue, en raw de préférence…

Écrit par : Laszlo Lebrun 13 Mar 2022, 16:45

eh bien, justement non! Voir ce que j'a écrit avant.

Et il n'y a pas de logiciels qui reconstiturent ce qui n'a pas été enrégistré.

Quand a l'appariel ad-hoc, j'aimerais bien pouvoir comparer avec de vrais hauts de gamme, mon D5100 ou D3000 sont aussi nuls que le Lumia ou mon K-Zoom.

Écrit par : jeandemi 13 Mar 2022, 18:34

Si tu les laisses en mode automatique ou programme, effectivement ça n'ira pas, mais pas à cause de l'appareil

Tu peux tout à fait faire un bracketting avec un D3000, en jouant sur la vitesse et/ou le diaphragme (et même sur la sensibilité si tu veux, mais ce n'est pas recommandé)

Le bracketting peut être automatique ou manuel, fait en RAW, en JPEG ou TIFF

Il est évidemment indispensable d'opérer avec l'appareil fixé sur un trépied, pour que les images à combiner soient identiques en cadrage

Les gros pâtés que tu observes sont dûs à la nature des capteurs à matrice de Bayer ET à l'illuminant qui sature les canaux (2 verts, 1 rouge et 1 bleu) et provoque des erreurs de dématriçage. Ça va mieux en RAW, mais l'idéal serait d'utiliser un capteur de type Foveon (Sigma) ou encore mieux un capteur monochrome +filtres de couleurs

C'est ce qui a fait que j'ai acheté un Leica Monochrom M246, car avec les éclairages LED en concerts, j'avais des taches de couleur irrattrapables sur les visages des musiciens, même en repassant la photo en noir et blanc (avec un M240 ou un Nikon Df)

Écrit par : Laszlo Lebrun 13 Mar 2022, 19:48

Tu peux tout à fait faire un bracketting avec un D3000, en jouant sur la vitesse et/ou le diaphragme (et même sur la sensibilité si tu veux, mais ce n'est pas recommandé)

Le bracketting peut être automatique ou manuel, fait en RAW, en JPEG ou TIFF

Il est évidemment indispensable d'opérer avec l'appareil fixé sur un trépied, pour que les images à combiner soient identiques en cadrage

Les gros pâtés que tu observes sont dûs à la nature des capteurs à matrice de Bayer ET à l'illuminant qui sature les canaux (2 verts, 1 rouge et 1 bleu) et provoque des erreurs de dématriçage. Ça va mieux en RAW, mais l'idéal serait d'utiliser un capteur de type Foveon (Sigma) ou encore mieux un capteur monochrome +filtres de couleurs

C'est ce qui a fait que j'ai acheté un Leica Monochrom M246, car avec les éclairages LED en concerts, j'avais des taches de couleur irrattrapables sur les visages des musiciens, même en repassant la photo en noir et blanc (avec un M240 ou un Nikon Df)

C'etait déjà en manuel.

En fait, si déjà en fort sous-exposition on a des pavés chroma saturés, aucun bracketting ne va marcher.

C'est vraiment un sujet qui révèle extraordinairement les mauvais capteurs.

Écrit par : jeandemi 13 Mar 2022, 21:57

Pas les mauvais capteurs, mais ceux à matrice de Bayer. Évidemment, si le dématriçage n'est pas bon, c'est encore pire

Je pense que les X-Trans de Fuji devraient souffrir de ce problème également, peut-être moins fort ?

Un éclairage différent (halogène par exemple) pose normalement moins de problèmes

Écrit par : Laszlo Lebrun 14 Mar 2022, 09:44

Oui, mais c'est pas l'objet. Il faut pouvoir photogrphier ce que l'œuil voit.

C'est avec des sujets problématiques qu'on voit la qualité des appareils, pas en photographiant des tulipes dans un soft-box.

Écrit par : Ducace 31 Mar 2022, 16:13

Oui, mais c'est pas l'objet. Il faut pouvoir photogrphier ce que l'œuil voit.

C'est avec des sujets problématiques qu'on voit la qualité des appareils, pas en photographiant des tulipes dans un soft-box.

Photographier ce que l'œil voit... moi je veux bien mais un capteur n'est pas exactement l'œil humain.

Déjà, l'œil humain voit en stéréo, ce qui donne l'impression de perspective et de profondeur. De plus, notre œil s'adapte à la lumière reçue et notre cerveau interprète.

Mais bon, commençons par le début, et les bases de la prise de vue.

1. mesurer la lumière.

Pour donner le résultat le plus proche de ce qu'on voit, il s'agit de mesurer correctement la lumière que reçoit l'objet (incidente) et pas la lumière que reçoit l'appareil (réfléchie).

Mesurer la lumière incidente se fait avec une cellule qu'on place à l'endroit du sujet. Elle va donner une mesure moyenne de la lumière effectivement reçue par le sujet, c'est cette mesure qu'il faut reporter sur l'appareil. Un bracketing éventuel se fera à partir de cette mesure, par exemple -1/+1 ou -2/+2, etc. selon l'écart entre les ombres les hautes lumières.

En réalité, le travail en RAW devrait permettre un bon résultat sans bracketing.

Le mesure de la lumière à l'aide de l'appareil ne peut que conduire à une dérive sur un sujet difficile. L'appareil n'étant calibré que pour des photos générales (paysages, portraits, etc.) il ne peut comprendre que ce qui est photographié est un DVD irisé.

2. l'expo

La sensibilité native d'un capteur est d'environ 160 ISO. C'est donc la meilleure référence pour une photo statique. Toute augmentation de la sensibilité ne conduit qu'on une amplification du signal et qui dit amplification dit distortion.

Les paramètres de prise de vue seront donc basés sur 160/diaph/vitesse.

Sur un sujet statique, on peut descendre la vitesse à n'importe quel niveau en mettant l'appareil sur trépied, avec l'avantage si on fait un bracketing que les images se superposent parfaitement.

On pourra donc choisir le diaphragme qu'on veut avec ou sans bracketing, la vitesse étant choisie en fonction de chaque diaphragme choisi.

3. le diaphragme

Le choix du diaph a deux incidences majeures:

- la profondeur de champ

- la diffraction.

Il s'agira donc de ne pas trop s'écarter de la zone où l'objectif est le plus performant. Les objectifs macro souffrent moins de la diffraction. Disons en gros que les ouvertures de diaph de F5,6 et F8 donnent les meilleurs résultats. 2,8, 4, et 11 donnent également des résultats satisfaisants avec une petite baisse de rendement.

Si vous avez des questions?

Écrit par : Laszlo Lebrun 31 Mar 2022, 17:42

Dans la cas du CD on a une situation particulière: le CD concentrant la lumiere reçue tout en la diffractant et en la décomposant en longueurs d'ondes plutôt pures.

Ca fait une enorme dynamique qui excède –de loin– les capacités des capteurs.

Cette photo est en fait un excellent test pour la qualité des capteurs !

Écrit par : jeandemi 1 Apr 2022, 10:07

C'est surtout un excellent test de la qualité du photographe et de sa compréhension du fonctionnement des capteurs, ici de la matrice de Bayer.

Si c'était juste une question de dynamique, un bracketting suivi d'un assemblage HDR suffirait à résoudre la totalité problème, or il n'en est rien.

Si ça peut résoudre le problème des zones brûlées ou enterrées (et du blooming ou éblouissement du capteur), il ne peut résoudre le problème du dématriçage du Bayer. Je ne suis pas sûr que l'architecture X-Trans de Fuji y arrive, plus probablement le Foveon de Sigma, l'idéal je pense serait un capteur monochrome (noir et blanc) comme Leica en fait sur ses boîtiers Monochrom, associé à des filtres colorés RVB sur l'objectif pour reconstituer une image couleur à partir de 3 photos, chacune d'une couleur de base.

Le problème du capteur de Bayer, c'est qu'il recompose 4 pixels colorés à partir de 4 photo-sites (2 verts, 1 rouge, 1 bleu) et que (pour simplifier) si la lumière est exclusivement d'une de ces composantes (exemple : le bleu), les autres photo-sites du capteur (rouge et verts donc) ne recevant rien, le logiciel chargé du dématriçage traduit ça par un à plat (bleu)

Plus que la qualité du capteur, c'est la qualité du logiciel qui importe! Travailler en RAW permet généralement de diminuer le problème, sans toutefois le résoudre complètement.

Pour complètement résoudre ça, il faut que le pixel coloré soit issu d'un seul photo-site recevant la totalité du signal, donc un Foveon sans interpolation ou un Monochrom + filtres

Écrit par : iAPX 22 Apr 2023, 12:47

[Note de la modération :

Extrait du sujet : https://forum.macbidouille.com/index.php?showtopic=424896 ]

Pour changer de sujet: toi qui sembles compétent en photo: Connais-tu in appareil numérique capable de rendre correctement les reflets colorés d'une source de lumière ponctuelle sur un CD?

Tout ceux que j'ai essayés me restituent des gros pavés de couleurs primaires saturées. Carrément dégeulasse.

C'est l'inverse, quand on observe soit-même la surface d'un CD de coté, éclairé par une lumière ponctuelle, c'est notre système de vision qui génère des aberrations, dont le célèbre bleu-jaune (Blau-Gelb), car chaque œil perçoit des reflets différents avec des couleurs différentes!

Le problème pour retrouver ces mêmes reflets n'est donc pas lié aux technologies numériques ou analogiques, car nécessitant un appareil stéréoscopique, et une exposition adaptée, nos yeux ayant une énorme capacité dynamique.

Utilise un appareil stéréoscopique, avec une exposition correcte, et tu retrouvera sur son écran 3D le phénomène que tu observes à l'œil nu (aux yeux nus) !

J"ai par exemple eu un Fuji W1 qui captait et reproduisait correctement les aberrations visuelles.

Ce message a été modifié par iAPX - Aujourd'hui, 13:55.

Écrit par : Laszlo Lebrun 23 Apr 2023, 16:15

Je n'y crois pas. En regardant avec un seul œil on voit la même chose: un dégradé arc-en-ciel parfait, pas de gros pavés de couleurs saturées

Écrit par : iAPX 23 Apr 2023, 17:07

Je n'y crois pas. En regardant avec un seul œil on voit la même chose: un dégradé arc-en-ciel parfait, pas de gros pavés de couleurs saturées

Corrige ton exposition et tout sera parfait!

Écrit par : Laszlo Lebrun 23 Apr 2023, 17:54

Je n'y crois pas. En regardant avec un seul œil on voit la même chose: un dégradé arc-en-ciel parfait, pas de gros pavés de couleurs saturées

Corrige ton exposition et tout sera parfait!

Ben non. Si je ne veux pas de pavés sursaturés il faut une sous-exposition telle, que le reste du CD est noir. Ce n'est pas non-plus ce que je vois.

Même en HDR, ça ne donne rien.

Il faudrait faire du stacking de la mort qui tue et recoller ça par ordi, mais ce n'est pas le but d'obtenir une image avec des heures de boulot en amont comme en aval, mais de bien de trouver quels appareils s'en sortent le mieux o.o.b. sans être obligé de bidouiller.

Écrit par : jeandemi 23 Apr 2023, 20:30

Ce que tu demande est impossible, il faudrait un capteur avec une dynamique de fou

Peut-être les anciens Fuji S3 et S5 Pro ?

Pour la saturation des canaux RVB provoquant des taches, je vois deux possibilités :

Un Sigma Foveon, où chaque photosite correspond directement à un pixel sans dématriçage de Bayer

Un capteur Monochrom (Leica) avec des filtres colorés devant l'objectif, 3 photos (R, V, B ) réassemblées dans Photoshop

Écrit par : ades 23 Apr 2023, 20:57

le vrai problème, c'est de trouver un dvd ou même un cd à photographier !!!

bon, je sors, désolé pour le bruit (puisqu'il s'agit d'image) ![]()

Écrit par : Laszlo Lebrun 23 Apr 2023, 21:06

Comme quoi la nature à encore quelques longueurs d'avance.

Pareil pour les photos de la Lune le soir ou les feux d'artifice.

Écrit par : iAPX 23 Apr 2023, 21:10

Comme quoi la nature à encore quelques longueurs d'avance.

Pareil pour les photos de la Lune le soir ou les feux d'artifice.

La dynamique de fou c'est justement le système de vision humaine, qui fait du stacking ou dur HDR suivant le point-de-vue, et créé une image de ce qui nous entoure en maintenant l'illusion que l'on voit tout à la fois: un système merveilleux, comme souvent avec la nature!

Écrit par : Laszlo Lebrun 23 Apr 2023, 22:04

Comme quoi la nature à encore quelques longueurs d'avance.

Pareil pour les photos de la Lune le soir ou les feux d'artifice.

La dynamique de fou c'est justement le système de vision humaine, qui fait du stacking ou dur HDR suivant le point-de-vue, et créé une image de ce qui nous entoure en maintenant l'illusion que l'on voit tout à la fois: un système merveilleux, comme souvent avec la nature!

Quand je regarde le CD et ses reflets je vois pourtant tout en une fois, avec une dynamique et un gammut a faire pâlir chaque expert en colorimétrie.

Écrit par : jeandemi 24 Apr 2023, 08:13

Parce que le cerveau fait du HDR très rapidement

Pourtant, en citant Edmond Rostand "comme lorsqu'on a trop fixé le soleil on voit ensuite sur toute chose un rond vermeil"

("Sur tout, quand j'ai quitté les feux dont tu m'inondes, mon regard ébloui pose des taches blondes")

Il n'y a pas que les capteurs qui peuvent être éblouis

Écrit par : iAPX 25 Apr 2023, 16:02

Les capteurs numériques sont très limités en terme de dynamique, non pas en valeur absolu, mais relativement à une exposition globalement correcte (Pas une sous-exposition brutale), sur les hautes-lumières.

C'était le cas il y a 20 ou 25 ans, et ça reste le cas: là où une pelloche vas encore capter de la lumière et des couleurs, pourtant trop puissantes, les capteurs numériques vont juste ressortir du blanc ou au mieux des blocks colorés quand observés à la loupe.

Ce dimanche j'étais sur un évènement, et justement, des conditions de lumière très variables et des fois des dynamiques nécessaires monstrueuses.

Comme je travaille en RAW, j'ai une marge de correction en plus, et je connais mon vieil appareil (Nikon D800E) qui possède quand-même un capteur incroyable dépassant les capacités de nombre d'objectif en terme de résolution tout en ayant une belle dynamique jusqu'à 800 ISO (la limite opérationnelle réelle).

Et donc j'ai du travailler, généralement à 800 ISO, en jouant sur la correction d'exposition, pour obtenir de bons résultats, professionnels, et qui d'ailleurs peuvent montrer plus que notre vue (via la sous-expo!).

Mais notre vue est globalement imbattable, des capteurs exceptionnels et un système de post-traitement faisant à la fois du stacking ou du HDR, aussi créant un composite de plusieurs captations, ce système est une tuerie!

Et même si on peut obtenir de beaux résultats depuis un capteur numérique, aucun écran, aucune impression, ne peut exposer (sic) correctement le résultat à hauteur de nos capacités visuelles, on est encore incroyablement loin, même si les technologies OLED sont un immense pas en avant.

Écrit par : Laszlo Lebrun 25 Apr 2023, 16:19

C'était le cas il y a 20 ou 25 ans, et ça reste le cas: là où une pelloche vas encore capter de la lumière et des couleurs, pourtant trop puissantes, les capteurs numériques vont juste ressortir du blanc ou au mieux des blocks colorés quand observés à la loupe...

Bien d'accord avec toi. Dommage que les tests de caméras fassent l'impasse sur ce point.

Pareil en acoustique où les sonomètres font du "stacking" en interne avec des gains de 1 à 1 million.

Il faut des micros de malade pour avoir cette dynamique et ça n'égale toujours pas une oreille entraînée.

Écrit par : iAPX 25 Apr 2023, 16:38

Pour ce qui concerne la voix captée, un exercice incroyablement difficile à tel point qu'une de mes référence pour cela date des années 60, en monophonie, et introuvable aujourd'hui...

https://www.youtube.com/watch?v=zhl-Cs1-sG4 est à écouter sur un système de référence, en portant attention à la voix de Giorgio Moroder, captée par différent microphones de très haute qualité, issus de différentes époques, marquant ainsi son histoire mais aussi celle de la voix enregistrée, c'est subtil mais à la fin brutal (le numérique assez pourri et traffiqué!).

Évidemment les premiers sont imparfaits, mais doux et chaleureux, le dernier intransigeant et probablement le pire de tous!

Le progrès?!?

PS: j'ai aussi été une "voix", sur des services téléphoniques, mais aussi pour des évènements, et je comprends la difficulté de la captation, la position de la tête, celle du micro, le micro lui-même, tout cela est essentiel pour reproduire le travail produit, les nombreuses répétitions avec des adaptations, du texte, de l'élocution de la diction, du placement de la voix, et in-fine avoir un beau résultat.

Propulsé par Invision Power Board (http://www.invisionboard.com)

© Invision Power Services (http://www.invisionpower.com)